在数字时代,万物皆可编码,而1到10这十个数字不仅是我们日常生活中最基础的计数单位,更是计算机软硬件研发的基石。它们以二进制、十进制、十六进制等形式,构建了现代科技的宏伟蓝图。

- 二进制的基础:计算机内部,所有数据最终被转化为0和1的组合。数字1代表“真”或“开”,而0代表“假”或“关”。例如,在硬件层面,晶体管通过开关状态(1或0)实现逻辑运算;软件层面,二进制编码驱动着算法和程序执行。

- 十进制与人类交互:尽管计算机内部使用二进制,但人类更习惯十进制。数字1到10在用户界面、数据输入和输出中无处不在,如软件版本号(如Windows 10)、文件大小(如10GB)或网络端口号(如80端口)。

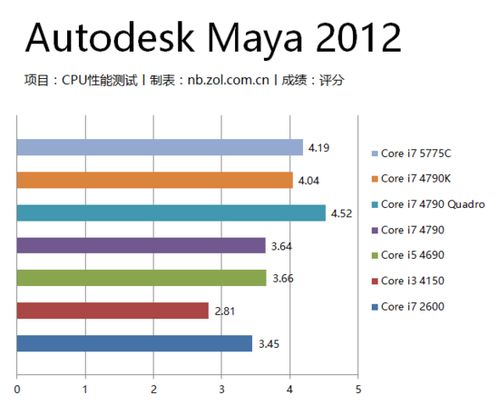

- 硬件设计中的数字:在硬件研发中,数字1到10常用于定义总线宽度(如32位处理器,涉及2的幂次)、时钟频率(如1GHz)或引脚编号。例如,一个10针的连接器可能用于数据传输,确保设备间稳定通信。

- 软件开发的核心:编程语言中,这些数字是常量、循环计数和数组索引的基础。例如,循环从1到10遍历数据,或使用数字10定义缓冲区大小。在算法中,数字1可能代表起始状态,而10可能表示阈值,如机器学习中的epoch次数。

- 编码与数据表示:计算机使用ASCII或Unicode编码字符,其中数字1到10对应特定代码点(如ASCII中‘1’为49)。在压缩算法中,数字10可能表示数据分块大小,优化存储和传输效率。

- 网络与协议:在互联网协议中,数字1到10用于定义状态码(如HTTP 200表示成功,404表示未找到),或IP地址分段(如192.168.1.10)。硬件如路由器利用这些数字进行数据包路由。

- 错误处理与调试:软件研发中,错误代码常以数字表示,例如返回码1表示一般错误,10可能表示超时。这帮助开发者快速定位问题,提升系统稳定性。

- 未来趋势:随着量子计算和人工智能发展,数字1到10的含义不断扩展。例如,在量子比特中,1和0可以叠加,而10可能代表量子门操作的次数,推动硬件创新。

从硬件电路到软件逻辑,数字1到10不仅是简单的符号,更是连接人类与机器的桥梁。它们体现了‘万物皆可编码’的理念,驱动着计算机技术的持续演进。在研发过程中,理解这些数字的深层含义,能帮助我们从微观到宏观构建更高效、可靠的系统。